Muchas veces por comodidad el usuario cae en el error de utilizar la misma para todo, estando el robo de credenciales detrás de más de la mitad de ciberataques

La desinformación y los ciberataques comprometen la estabilidad de los países durante los procesos electorales

El futuro de un país democrático se determina en los procesos electorales, pero la desinformación y los hackeos pueden ponerlo en riesgo. ¿Cómo evitarlo?

Más de 60 países tienen elecciones en 2024, abarcando cerca de la mitad de la población mundial. Se trata de un año histórico para el ejercicio de la democracia en el mundo, y al mismo tiempo estamos asistiendo a un auge sin precedentes en la desinformación online y los ciberataques que buscan desestabilizar esos procesos electorales. Ningún país se libra de este problema, que puede agravarse de forma considerable en los próximos años.

Particularmente problemáticas son las elecciones presidenciales en los Estados Unidos, donde tanto Donald Trump como Joe Biden se disputarán la presidencia el próximo mes de noviembre. El gran peso de los Estados Unidos en la política y la economía globales hace que haya muchas partes interesadas en inclinar la balanza a favor de uno u otro candidato, con lo que se espera un auténtico bombardeo de desinformación en internet.

La IA agrava el problema como nunca antes

Los intentos de desinformación han sido comunes en todos los procesos electorales, y se han extendido especialmente desde el auge de las redes sociales. En los últimos 15 años han aparecido millones de cuentas falsas en Facebook, Instagram, Twitter ?ahora X? o TikTok, divulgando información falsa o sesgada sobre el rival político de turno. En los últimos dos años, sin embargo, estas cuentas falsas han crecido de forma exponencial.

La inteligencia artificial es la responsable. Herramientas como ChatGPT facilitan el proceso de redactar mensajes políticos con fines de propaganda en docenas de idiomas diferentes, lo que permite a partes interesadas en países como China o Rusia crear miles de cuentas 'bot' y lanzar mensajes con desinformación en perfecto inglés ?o francés, alemán o español, según sea el caso?. Basta con un simple 'prompt' de texto, y la IA se encarga de todo lo demás.

Y no solo eso. Las APIs de las herramientas de IA pueden permitir a los ciberatacantes crear aplicaciones más elaboradas que no solo lancen mensajes propagandísticos de forma automática en las redes, sino que también respondan a las interacciones en estas plataformas sin apenas supervisión por parte del ciberdelincuente. Esto hace que las cuentas falsas resulten todavía más difíciles de identificar e interceptar.

El peligro de los 'deepfakes' ya está causando estragos

Aún más grave es el problema de los 'deepfakes': imágenes, audios o vídeos falsos generados mediante la tecnología IA más avanzada. La inteligencia artificial permite crear vídeos falsos con el rostro y la voz de personas reales de manera cada vez más sencilla y más realista. En sus inicios, los 'deepfakes' se utilizaron de forma predominante para crear contenidos sexuales falsos protagonizados por actrices o cantantes, y ahora se emplean también para desinformar.

Existen numerosos vídeos en circulación con Joe Biden o Donald Trump diciendo cosas que nunca han dicho, y lo peor es que resulta muy difícil distinguir estos vídeos falsos. Se hace necesario acudir a las fuentes originales ?por ejemplo la cuenta de X de Biden, o el perfil en Truth Social de Trump? para contrastar si el video falso era cierto o no, un proceso que la mayoría de la gente no se molesta en hacer.

Lo peor es que los 'deepfakes' pueden elaborarse a partir de la imagen y la voz de cualquier persona. Nuestros propios vídeos personales pueden servir a un ciberatacante para crear contenidos falsos con nuestra imagen. Estos vídeos se pueden obtener desde las redes sociales o interceptando nuestra conexión a internet. Por eso debemos cifrarla con una VPN para mantener nuestros contenidos multimedia lejos de los hackers y prevenir su uso abusivo.

Las redes sociales endurecen sus medidas de control

Ante el auge de la desinformación, las redes sociales están tratando de establecer controles más eficaces para prevenir la creación de cuentas falsas y la divulgación de información errónea. Mientras que plataformas como Meta, YouTube o TikTok solo utilizan mecanismos internos para esto, X incorpora además por desarrollar el sistema de las ?Community Notes? para que cualquier usuario pueda rebatir la información falsa distribuida en su plataforma.

A pesar de los esfuerzos de las redes sociales, el problema radica en las empresas de inteligencia artificial. Compañías como OpenAI siguen operando sin apenas control gubernamental, con un claro ánimo de lucro que ha conducido a la dimisión de buena parte de su comité de ética y seguridad. Este comité está ahora liderado por Sam Altman, el CEO de la compañía, con lo que difícilmente ejercerá un control real sobre los riesgos de su IA.

Además, OpenAI no es la única empresa de inteligencia artificial que supone un riesgo para la información digital. Prácticamente todas las Big Tech se están lanzando a la carrera para elaborar nuevos modelos de IA, desde Gemini en el caso de Google hasta Llama en el caso de Meta. Sin un estricto control gubernamental, la explosión de estas herramientas de IA agravará de forma considerable el problema de la desinformación en las elecciones democráticas.

David Escudero destaca el "interés" de las factorías locales de automoción para procesos "mucho más eficientes"

Datos que, al parecer, se habrían puesto a la venta en un foro especializado en compraventa de información robada en ataques informáticos

La industria del cribercrimen es enorme y, si fuera un país, sería la tercera economía del mundo sólo por detrás de Estados Unidos y China

A través de la línea 105 XTantos, una ruta guiada por una pequeña muestra de las actividades que la Iglesia realiza en nuestro entorno más cercano

Criticas socialistas a la externalización del servicio y la falta de participantes en más de la mitad de los talleres

Por cerca de un millón de euros

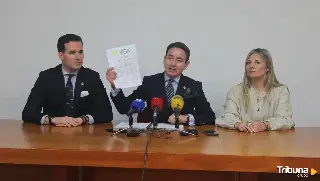

José Manuel Lorenzo asegura que ya se han cumplido 23 de los 30 puntos recogidos en el acuerdo firmado con Por Ávila el pasado mes de octubre